谷歌AI绘制大脑神经地图,开源代码帮你理清混乱的脑回路

作为一只AI,该如何观察碳基生物的脑回路?

这个问题,是21世纪“人脑逆向工程”,通往超级AI的路上,需要解决的要事。

谷歌AI要给动物的大脑 (或者局部) ,画出一张3D脑神经地图,来研究它们思考时,走过的神经路线。

比如,给小鸟的大脑画张地图,就能观察到它是怎么唱歌的了。

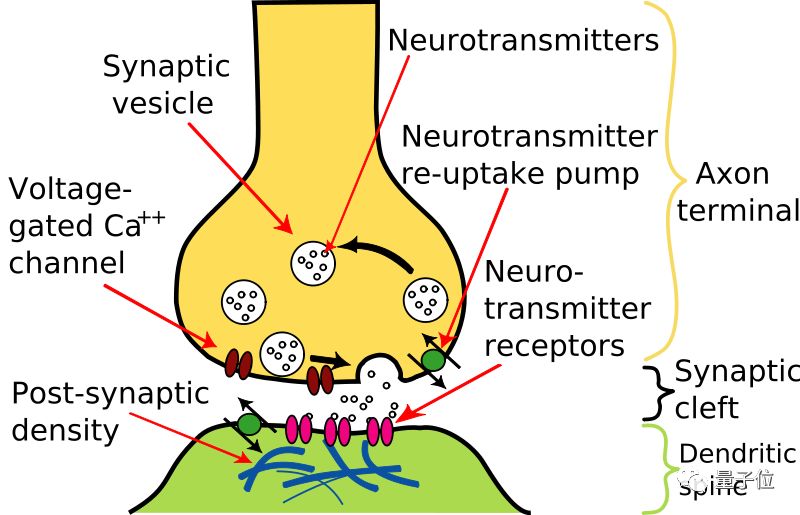

然而,这项任务并不简单,需要以纳米级的分辨率,给脑组织做3D成像。然后,算法要分析图像里的数据,找到神经元产生的突起,才能发现细胞与细胞之间的突触连接。

由于对图像质量要求很高,即便是毫米级的脑组织,也会产生1000TB以上的数据。

画好地图,主要的难点就是解释这些数据。于是,谷歌决定跟马普所 (MPI) 并肩战斗,就像当初英特尔和麻省理工 (MIT) 联手那样。

不过,团队表示自家的成果,比起今年3月英特尔发布的算法,准确度提升了一个数量级。

于是,谷歌的脑神经地图AI,在Nature Methods期刊上发表了。

那就一起来看一下,这地图是怎么画的吧。

Flood Filling三维图像分割

首先,在庞大的显微镜数据之中,追踪神经突起,是个不小的图像分割工程。

传统算法通常分两步:

先是要找到突起和突起之间的分界线,这里会用到边缘检测器,或者是机器学习分类器。

然后,把每个像素分配到它该在的组别,没有被分界线隔开的话,就分到一起。可以用分水岭 (Watershed) 算法,Graph Cut算法也行。

不过,谷歌团队尝试用一个基于RNN的算法,将两步并作一步。

把算法种在某个像素点上,让它在那里生根发芽――用RCNN预测哪些像素,和开始那一点属于同一个物体,把它们填上一样的颜色就好了。

各种不同的颜色,都是Flood Filling网络自动填的。

ERL测量准确度

预期运行长度(Expected Run Length) 这个指标,是谷歌和马普所一起设计出来的。

在一张3D大脑图像上,给定某个神经元上的某个随机点,从那里开始追踪。那么,走出多远,算法跟踪就会出错?这就是ERL。

其实,和平均故障间隔(MTBF) 道理一样,只是这里测量的是距离,不是时间。

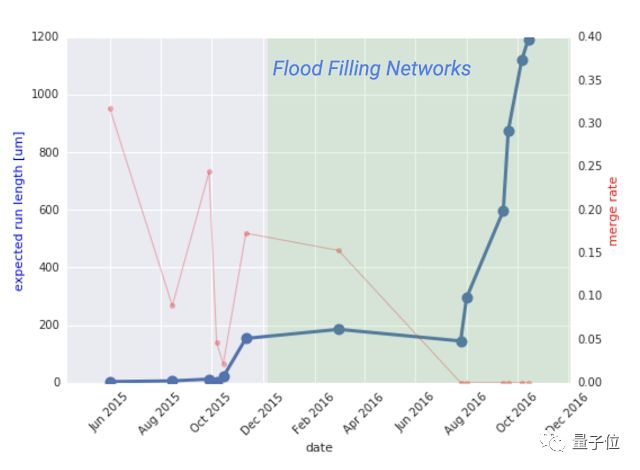

蓝线表示,预期追踪距离 (ERL) ,可以看出随着时间的推移,进展可观。

红线表示,错把两个神经元当成一个,的频率。错误率越来越低,也令人欣慰。

小鸟小鸟,1.76传奇新服网,给我唱首歌

大概你还记得,文章开头挖了坑的,小鸟唱歌。

△斑胸草雀,胸前有高贵的斑马纹,也叫珍珠鸟,会唱歌

谷歌团队真的给一只珍珠鸟的 (一部分) 脑回路 ,做了三维地图。

用参考标准 (Ground Truth) 数据集验证了一下,ERL结果表明,神经元分割的准确度,比前辈们都要好。

金黄色的小球,是两个神经元之间,突触连接的部分。

算法出错不多,只花了很少的人力去修改。现在,马普所的研究人员已经可以用这份地图,来研究鸟鸣时的大脑活动了。

一般生物表示,天籁和音痴的脑回路,大概会很不一样吧。

△别开腔,自己人

开源是件幸福的事

论文发表的同时,谷歌AI不忘普天同乐,在GitHub上提供了所用模型的TensorFlow代码。

另外,还有做可视化用的WebGL 3D软件。

大家随意领取。

TensorFlow代码传送门:

https://github.com/google/ffn/

WebGL 3D传送门:

https://github.com/google/neuroglancer

(付费) Nature Methods论文传送门:

https://www.nature.com/articles/s41592-018-0049-4

(不付费) 旧版论文传送门:

https://www.biorxiv.org/content/biorxiv/early/2017/10/09/200675.full.pdf

― 完―